Fausses vidéos du cambriolage du Louvre générées par IA

💡 En résumé : Depuis le cambriolage au musée du Louvre, survenu dimanche dernier, des vidéos truquées générées par intelligence artificielle, prétendant montrer cet événement, circulent sur Internet. Ces contenus, créés principalement par le modèle Sora 2 d’OpenAI, soulèvent d’importantes questions sur la désinformation, la sécurité numérique et l’impact des technologies d’IA sur la perception de la réalité.

Le cambriolage du musée du Louvre : un événement marquant

Le musée du Louvre, lieu emblématique et l’un des plus fréquentés au monde, a été le théâtre d’un audacieux cambriolage dimanche dernier. Cet incident a choqué à la fois les amateurs d’art et les autorités, attirant l’attention des médias du monde entier. En effet, le musée abrite des œuvres inestimables, allant de la Mona Lisa à la Vénus de Milo. La sécurité autour de ces œuvres d’art est donc d’une importance capitale.

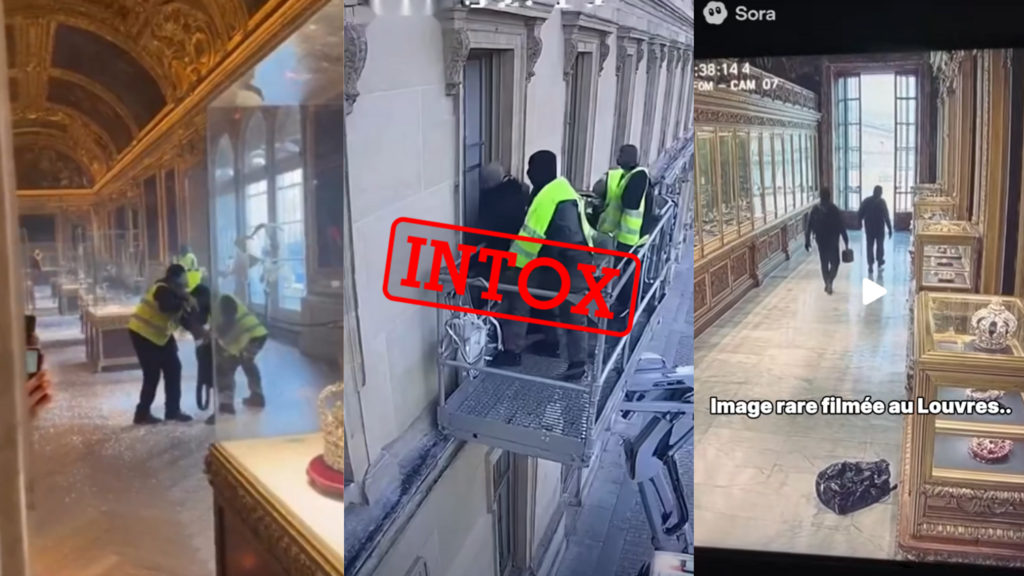

Les circonstances exactes du vol demeurent floues, mais il est impératif de noter que cet événement a donné naissance à une vague de contenus médiatiques, notamment des vidéos prétendument filmées au moment du cambriolage. La rapidité avec laquelle ces vidéos se sont répandues sur les réseaux sociaux en dit long sur la réaction du public face à ce type d’événement.

Des vidéos trompeuses générées par IA

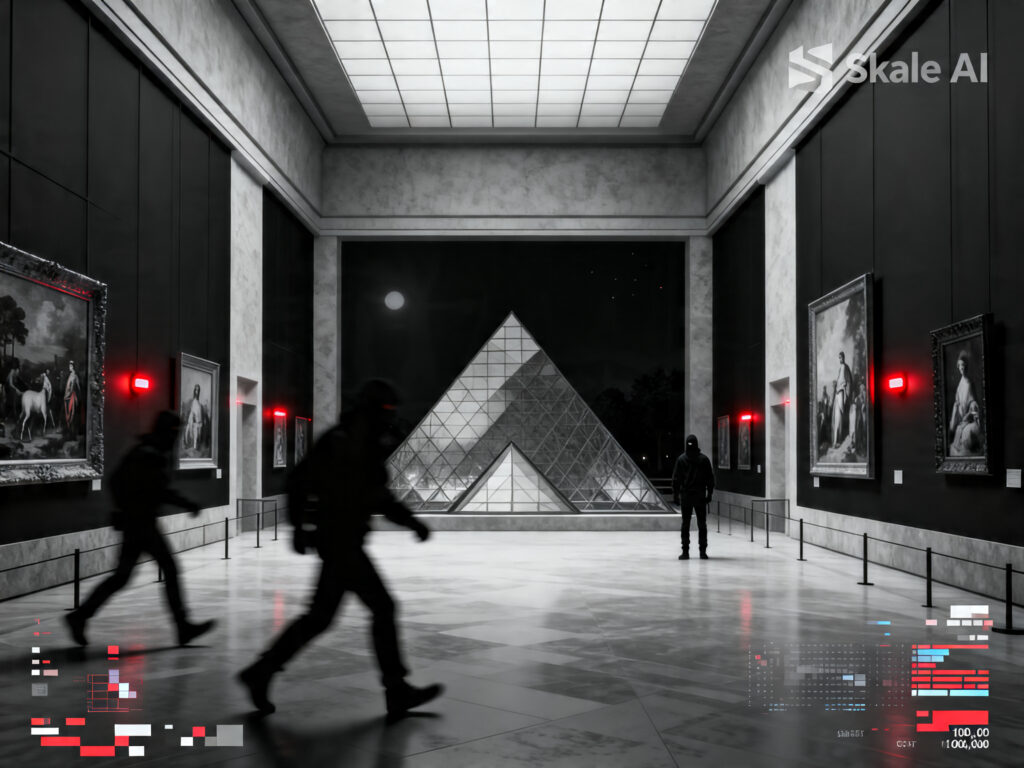

À la suite du cambriolage, de nombreuses vidéos ont vu le jour, prétendant capturer le moment précis du vol. Ces vidéos, souvent impressionnantes, sont en réalité le fruit d’algorithmes d’intelligence artificielle, en particulier du modèle Sora 2 développé par OpenAI. Ce dernier utilise des techniques avancées de génération vidéo pour créer des contenus attrayants, mais fictifs.

Les techniques de génération de vidéos par IA se basent sur des réseaux de neurones profonds qui apprennent à reproduire des scènes à partir de modèles préexistants. L’outil Sora 2 a conduit à des créations qui, malgré leur nature fausse, peuvent sembler convaincantes pour le spectateur non averti.

Les implications de la désinformation par vidéo

La prolifération de fausses vidéos pose des problèmes sérieux en matière de désinformation. Dans une ère où les informations peuvent se répandre rapidement, la capacité à distinguer le vrai du faux devient cruciale. La situation du cambriolage au Louvre met en lumière le rôle que jouent les technologies d’IA dans la propagation de fausses informations.

De telles vidéos peuvent avoir des conséquences désastreuses. Non seulement elles peuvent semer la confusion parmi le public, mais elles peuvent également interférer avec les enquêtes officielles. Les forces de l’ordre, par exemple, doivent naviguer entre la réalité et la fiction, compliquant ainsi leur tâche de rétablissement des faits. Par ailleurs, ces vidéos altèrent la perception du public sur la réalité, engendrant une méfiance générale vis-à-vis des médias.

La réaction du public et des autorités

Face à cette situation, les réactions ont été variées. D’une part, certains utilisateurs des réseaux sociaux s’interrogent sur l’authenticité de ces vidéos truquées ; d’autre part, d’autres sont influencés par leur réalisme et les prennent pour des témoignages réels. Cela soulève des questions éthiques sur la responsabilité des plateformes de médias sociaux dans la modération des contenus.

Les autorités, quant à elles, ont lancé des avertissements sur la nécessité de vérifier les sources d’information. Elles encouragent le public à faire preuve de prudence au moment de partager des contenus qui pourraient s’avérer trompeurs. Des experts en communication et en sécurité numérique soulignent l’importance d’une éducation accrue sur les médias et la désinformation.

Les défis techniques et éthiques des systèmes de génération vidéo

Avec l’avancement des technologies d’IA, il est essentiel d’explorer les défis techniques et éthiques qui émergent. D’une part, le développement de modèles comme Sora 2 ouvre des perspectives fascinantes pour les créateurs de contenus. D’autre part, il présente des risques significatifs de mauvaise utilisation. Les entreprises technologiques font face à la nécessité de réguler ces outils pour empêcher leur usage abusif.

Il est important de noter que, bien que la technologie puisse générer des vidéos de haute qualité, la question de la responsabilité reste floue. Qui est responsable lorsqu’un contenu trompeur cause des dégâts ? La question appelle un débat sur la réglementation des technologies d’IA et leur impact sur la société.

Les solutions pour contrer la désinformation

Pour faire face à cette problématique croissante, plusieurs solutions peuvent être envisagées. Tout d’abord, les gouvernements et les organismes concernés doivent instaurer des législations claires concernant la fabrication et la distribution de contenus générés par IA. De plus, les plateformes de médias sociaux devraient intensifier leurs efforts pour identifier et signaler les contenus trompeurs.

Ensuite, l’éducation du public sur la désinformation est cruciale. Des campagnes éducatives devraient être mises en place pour aider les utilisateurs à développer une pensée critique face aux contenus en ligne. En apprenant à vérifier les sources et à comprendre les techniques de manipulation, les internautes seront mieux préparés à discerner le vrai du faux.

Un aperçu des conséquences futures

À l’avenir, la capacité de générer des vidéos de manière réaliste continuera probablement à progresser. Si des mesures efficaces ne sont pas mises en place, cela pourrait nuire à la confiance du public envers les médias et les institutions. La création de « deepfakes » et d’autres contenus trompeurs pourrait devenir la norme, rendant la lutte contre la désinformation encore plus complexe.

Il est donc impératif que les différents acteurs – technologues, journalistes, éducateurs et législateurs – unissent leurs efforts. Ensemble, ils peuvent développer des solutions novatrices et réglementaires visant à préserver l’intégrité de l’information tout en exploitant les avantages des technologies d’IA.

Conclusion

En définitive, la situation engendrée par les fausses vidéos du cambriolage au Louvre illustre bien les défis contemporains posés par l’intelligence artificielle dans le domaine de la communication. La convergence entre technologie et désinformation pose des questions complexes et nécessite une approche collaborative pour garantir une information fiable et de qualité.

Les expériences récentes soulignent l’importance vitale d’adopter une approche proactive pour éduquer le public et réguler les technologies potentiellement nuisibles. En somme, mieux comprendre la dynamique entre l’IA et la désinformation s’avère essentiel pour naviguer dans ce paysage en constante évolution.

Images du cambriolage et de la désinformation en ligne