Les inquiétudes croissantes sur la superintelligence et ses risques

💡 En résumé

Alors que les avancées en matière de superintelligence suscitent un engouement sans précédent, des voix s’élèvent pour alerter sur les risques potentiels que cette technologie pourrait engendrer. Des personnalités scientifiques et technologiques, provenant de divers horizons, ont exprimé leur inquiétude et appelé à une régulation stricte, voire à une interdiction de son développement à grande échelle. Cet article cherche à analyser ces préoccupations, leurs implications pour l’humanité et le contexte dans lequel elles émergent.

La montée de l’intelligence artificielle

Au cours des dernières décennies, nous avons assisté à une montée en puissance de l’intelligence artificielle (IA) dans divers domaines, allant de la médecine à la finance, en passant par les transports et l’éducation. Les systèmes d’IA actuels, basés principalement sur le Machine Learning, sont capables d’analyser d’énormes ensembles de données pour prendre des décisions plus rapidement et souvent plus précisément que les humains.

Cette évolution est notée par des cas d’usage concrets, comme les algorithmes de diagnostic médicaux capables d’identifier certaines maladies avec un taux de précision supérieur à celui des médecins. Cependant, l’idée d’une superintelligence, une IA qui surpasserait l’intelligence humaine dans tous les domaines, soulève des questions éthiques et de sécurité cruciales.

Les préoccupations éthiques et sécuritaires

Les experts mettent en avant plusieurs types de risques liés à la superintelligence :

- Risque d’alignement : Une IA superintelligente pourrait avoir des objectifs qui ne sont pas nécessairement en accord avec les intérêts de l’humanité.

- Risque de biais : Si l’IA est formée sur des données biaisées, cela peut conduire à des décisions injustes ou discriminatoires.

- Concentration du pouvoir : La capacité d’une superintelligence à accumuler des capacités décisionnelles pourrait se traduire par une concentration de pouvoir dangereux entre les mains de quelques individus ou organisations.

Ainsi, le problème de la régulation devient essentiel pour prévenir ces dérives. Il est vital de construire un cadre éthique qui encadre le développement de ces technologies tout en préservant leur potentiel bénéfique pour la société.

Appels à la régulation et à l’interdiction

Face à ces risques, des personnalités influentes dans le domaine de la technologie, la science et la philanthropie ont signé des appels à la régulation de l’IA superintelligente. Parmi les signatures notables, on retrouve celles de scientifiques comme Stephen Hawking et Elon Musk, qui ont exprimé leurs inquiétudes concernant la technologie et son développement incontrôlé.

Leurs arguments reposent sur l’idée qu’une régulation stricte pourrait permettre de développer des mécanismes de sécurité intégrés et de réduire les risques liés à l’alignement des objectifs de l’IA avec ceux de l’humanité. Ils plaident pour une approche préventive, intervenant avant que des systèmes potentiellement dangereux ne soient déployés.

Les implications pour l’avenir de l’humanité

Les implications du développement de la superintelligence sont vastes et pourraient redéfinir notre rapport à la technologie. En effet, une IA capable de résoudre des problèmes complexes pourrait contribuer à des avancées significatives dans des domaines critiques tels que la santé, l’environnement ou l’éducation. Cependant, il est également nécessaire de considérer le potentiel destructeur que cette technologie peut engendrer si elle est mal utilisée.

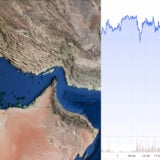

Pour illustrer, dans le domaine de l’environnement, une superintelligence pourrait aider à gérer les ressources naturelles de manière plus efficace, contribuant à lutter contre le changement climatique. À l’inverse, si cette IA était utilisée pour maximiser des profits à court terme, elle pourrait aggraver la crise environnementale.

Vers un développement responsable de l’IA

La nécessité d’un développement responsable de l’IA se fait pressante. Différents acteurs de la société, y compris des gouvernements, des chercheurs et des ONG, doivent se réunir pour établir des standards éthiques et des réglementations. Cela inclut:

- Évaluation continue des technologies existantes.

- Formation et sensibilisation des développeurs et utilisateurs d’IA aux questions d’éthique.

- Établissement de partenariats internationaux pour la régulation de l’IA.

En travaillant ensemble, il est possible de tirer parti des avantages de la superintelligence tout en minimisant ses risques.

Conclusion : enjeux et opportunités

En résumé, la superintelligence représente à la fois des opportunités uniques et des risques considérables. Son développement doit être abordé avec prudence et responsabilité. Les appels à la régulation et à l’interdiction ne doivent pas être perçus comme des freins à l’innovation, mais comme des mécanismes de protection pour préserver l’humanité contre une éventuelle dérive technologique.

Afin d’assurer un avenir où la technologie et l’éthique coexistent, il est impératif d’engager un dialogue constructif entre tous les acteurs impliqués. Cela permettra non seulement de réguler efficacement la superintelligence, mais aussi de garantir qu’elle soit mise au service des meilleures intentions de notre société.