L’IA permet à une victime de s’exprimer en cour : enjeux éthiques

💡 En résumé : L’utilisation de l’intelligence artificielle (IA) pour permettre à des victimes de délivrer des déclarations d’impact lors de procédures judiciaires suscite des enjeux éthiques considérables. Cet article examine un cas emblématique où une version réaliste d’une victime a été utilisée pour s’exprimer en cour, analysant les implications légales, morales et techniques de cette pratique novatrice.

Introduction : quand la technologie rencontre la justice

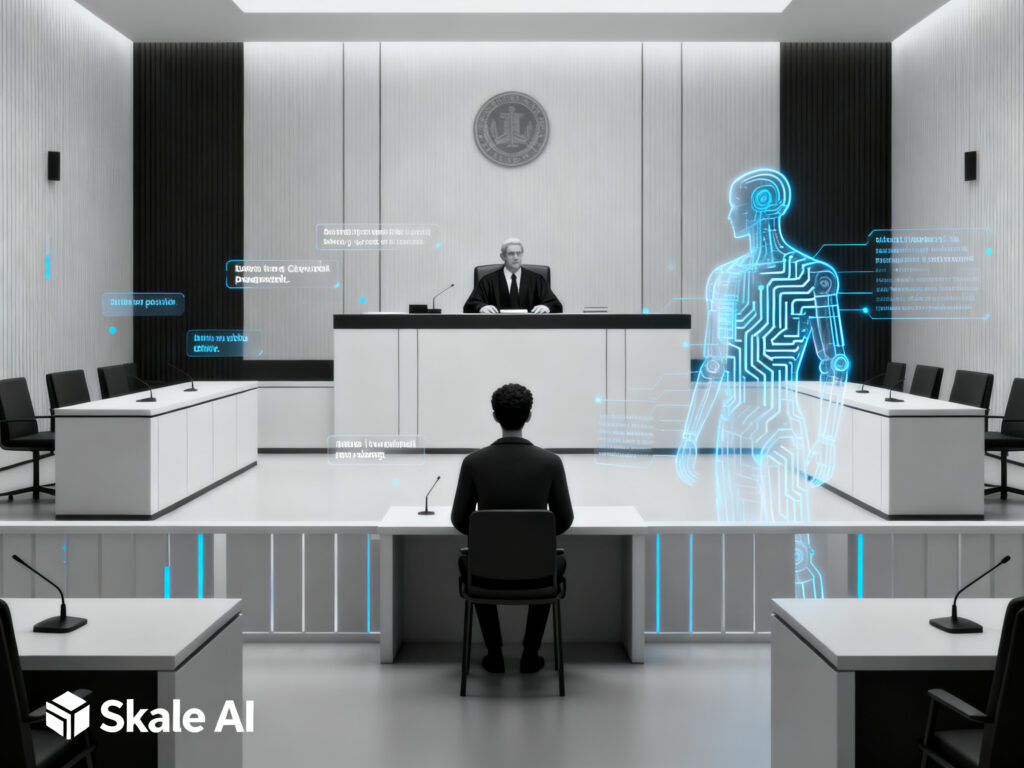

La justice est traditionnellement perçue comme un sanctuaire de la parole humaine, où chaque témoignage a un poids spécifique. Cependant, avec les avancées rapides de l’intelligence artificielle, des solutions innovantes apparaissent, comme l’usage de l’IA pour permettre à une victime d’exprimer ses sentiments à l’aide d’une représentation numérique. Ce phénomène, bien que révolutionnaire, soulève une multitude de questions éthiques et juridiques.

Dans le cas récent de Chris Pelkey, un ancien soldat américain assassiné lors d’un incident de rage au volant, une version générée par IA de lui-même a pris la parole en cour. La décision d’utiliser cette technologie afin de transmettre un message de pardon au meurtrier a ouvert la voie à un débat sur la place de l’IA dans les tribunaux.

La question que nous devons explorer est la suivante : l’IA peut-elle véritablement représenter la voix des victimes, ou cette pratique risque-t-elle de déshumaniser le processus judiciaire ?

L’affaire Chris Pelkey : un cas à l’origine d’un changement ?

Chris Pelkey, un homme de 37 ans, a été abattu à un feu rouge en 2021. Lors de la condamnation de son meurtrier, Gabriel Horcasitas, la cour a innové en permettant à une version numérique de Pelkey de s’exprimer. Cela s’est concrétisé par un enregistrement vidéo où l’IA reproduisait son apparence et sa voix, le tout afin de délivrer une déclaration d’impact.

Dans cette vidéo, Pelkey (via l’IA) a exprimé des sentiments de pardon, déclarant : « Dans une autre vie, nous aurions pu être amis. Je crois au pardon. » Ces mots, lourds de sens, ne sont pas seulement une déclaration personnelle mais également un tournant dans la perception de ce que peut être la justice réparatrice.

Cette utilisation de l’IA a suscité des applaudissements pour son caractère novateur, mais elle a également déclenché des inquiétudes quant à la façon dont l’IA pourrait interpréter des émotions humaines complexes.

Les implications éthiques de l’IA dans le système judiciaire

L’usage de l’IA pour retranscrire la voix des victimes soulève plusieurs questions éthiques. Dans quelle mesure une machine peut-elle capturer l’essence des émotions humaines ? L’IA, bien qu’avancée, fonctionne sur des algorithmes et des données, ne pouvant jamais ressentir de l’empathie comme un être humain.

Les craintes se portent également sur la possibilité que ces représentations soient manipulées ou mal interprétées, dénaturant le rôle de la victime dans la procédure. Qui est responsable si un témoignage virtuel est perçu comme faussé ou inapproprié ?

Enfin, la question de l’authenticité se pose : l’expérience d’un message délivré par IA peut-elle vraiment s’aligner sur l’expérience vécue par des victimes réelles ?

Le cadre légal autour de l’utilisation de l’IA en justice

Le cadre légal reste flou en ce qui concerne l’utilisation de l’IA dans les procès judiciaires. Alors que certains États, comme l’Arizona, prennent l’initiative d’incorporer la technologie, d’autres pays affichent encore une posture conservatrice. Cette disparité dans les lois soulève des défis en matière d’uniformité et de transparence dans le système judiciaire.

Il reste à déterminer comment ces nouveaux outils seront régulés. Qui supervisera le développement d’IA, et comment garantiront-ils que ces technologies ne créent pas de biais supplémentaires ? Une législation spécifique doit être mise en place pour traiter des implications de l’IA sur les droits des victimes, le respect de leur mémoire et la manière dont ces témoignages peuvent influencer un procès.

Les enjeux psychologiques et sociaux de l’IA

Au-delà des implications légales et éthiques, il est crucial de considérer les enjeux psychologiques liés à l’utilisation de l’IA en justice. La manière dont les victimes et leurs familles perçoivent un témoignage généré par IA peut varier considérablement. Certains pourraient le voir comme un moyen de rétablir un certain contrôle, tandis que d’autres pourraient éprouver une sensation de déconnexion.

Comment ces nouvelles pratiques affectent-elles les relations entre la justice et les victimes ? L’IA modifie-t-elle la manière dont les victimes sont entendues ? Une partie du public pourrait également manifester une réticence à accepter des témoignages virtuels comme valides.

Vers une hybridation des témoignages : l’avenir de l’IA dans la justice

Il est indéniable que l’IA jouera un rôle de plus en plus prépondérant dans le système judiciaire. Dans l’avenir, nous pourrions envisager une hybridation des témoignages, où des éléments humains et numériques coexisteraient pour enrichir la narration des événements.

Cependant, un équilibre délicat doit être trouvé pour s’assurer que l’émotion et l’empathie ne soient pas perdues dans le processus. La technologie ne devrait pas remplacer l’humain ; elle devrait le compléter et l’aider à porter la voix des victimes de manière plus audible et respectueuse.